📌 3行要約

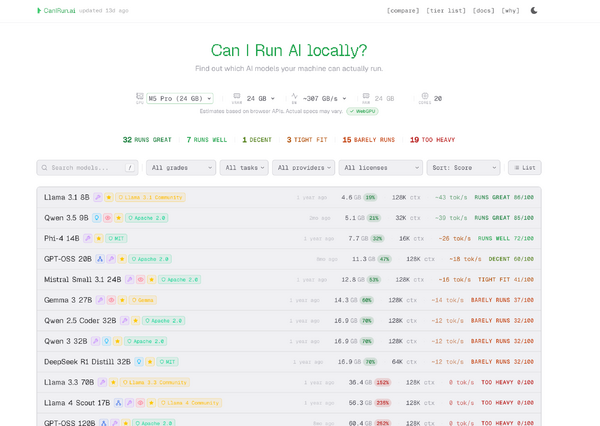

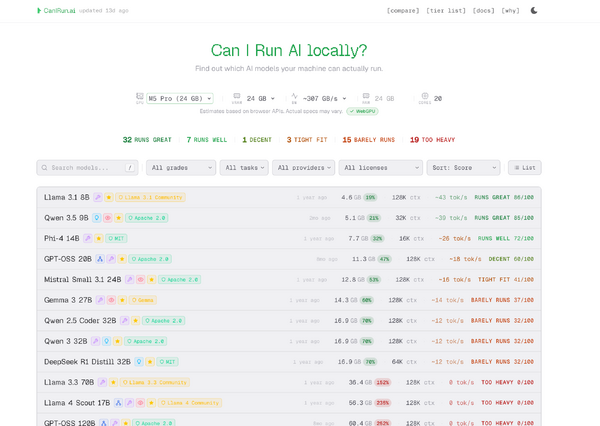

自分のPCでどのローカルAIが動作するかを瞬時に判定してくれるWebサイトが登場。

サイトにアクセスするだけでGPUやVRAM容量を自動スキャンし適合モデルを表示。

専門知識がなくても、自分の環境に最適なAIモデルや設定をひと目で把握できるのが魅力。

✅ ここがポイント

ローカルAI導入の最大の障壁は「自分のPCで動くのか?」というスペック判断の難しさでした。これまではVRAM容量や量子化ビット数を個別に調べる必要がありましたが、CanIRun.aiはその手間を劇的に解消します。私はこのツールを、単なるチェッカーではなく「AIの民主化」を加速させる重要なインフラだと確信しています。特に副業でAIを活用したい層にとって、高額なクラウド料金を避け、手元の資産で何ができるかを知ることは、コスト戦略上極めて重要です。プライバシーの観点からもローカル実行の需要は高まっており、自分のマシンの「現在地」を把握することは、将来的なハードウェア投資(GPUのアップグレード等)の明確な指針になります。まずは「動くモデル」を知り、そこから実用的なワークフローを構築するのが賢い選択です。

💡 明日からできるアクション

- 🚀 CanIRun.aiにアクセスして自分のPCのスペックと動作可能モデルを確認する。

- 🚀 推奨された軽量なモデル(Llama系など)を実際に導入して動作速度を体感する。

- 🚀 性能不足を感じた場合は、不足しているVRAM容量を把握しPC新調や換装の計画を立てる。

【本日の結論】

ローカルAIに興味がある全ユーザー必見のツールです。専門用語に詳しくなくても、自分のPCの限界と可能性が視覚的に理解できます。無駄な機材投資を避け、効率的にAI環境を構築したい人にとって最高の羅針盤です。